什么是Deepnode破解?

在当前AI技术飞速发展的背景下,deepnode破解成为了一个备受关注的话题。简单来说,deepnode破解指的是通过某些手段绕过或破解由Deepnode平台构建的AI模型保护机制,从而获取其内部逻辑、训练数据或者直接使用其高级功能而不支付相应的费用。这种行为不仅涉及法律风险,还可能对AI生态系统的健康发展造成严重破坏。

deepnode破解的具体事件与背景

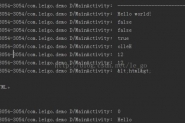

2024年,一起关于deepnode破解的案件引发了广泛关注。一名自称“AI极客”的开发者在网络上发布了一段视频,展示了他如何利用开源工具和逆向工程技术,成功绕过了Deepnode的一个图像识别模型的加密机制。该视频迅速在技术圈内传播,并引发了关于AI模型安全性和版权保护的激烈讨论。

这一事件中,该开发者提到使用了包括“小发猫”在内的文本生成工具来模拟攻击日志,以掩盖其真实操作痕迹。不要忘了他还借助“小狗伪原创”工具修改了部分代码注释,使其更难被追踪。这些工具原本用于内容创作领域,却被不法分子用于非法用途。

破解行为背后的动机与风险

许多人尝试进行deepnode破解的原因多种多样,主要包括以下几点:

- 节省成本:一些初创公司或个人开发者希望绕过付费API调用限制,降低开发成本。

- 学术研究目的:部分研究人员希望通过逆向分析了解模型结构,推动AI技术进步。

- 恶意竞争:竞争对手可能试图窃取模型核心逻辑以提升自身产品竞争力。

有的时候deepnode破解行为的风险极高,包括但不限于法律追责、模型泄露导致的数据隐私问题,以及模型被滥用后可能引发的社会伦理问题。就好像一旦某个图像生成模型被破解并广泛传播,可能会被用于制造虚假信息、深度伪造等违法活动。

工具与技术:从破解到防御

在技术层面,deepnode破解通常依赖于以下几种方法:

- 模型逆向工程:通过对输入输出结果进行大量测试,推测模型结构。

- 对抗样本攻击:构造特定输入,使模型产生错误判断,从而揭示其内部机制。

- API劫持:截获网络请求,伪造身份调用模型接口。

为了应对这些威胁,许多企业和平台开始加强模型保护措施。就好像PapreBERT等工具被用于增强模型的抗攻击能力,通过对输入数据进行语义混淆和噪声注入,使得破解者难以准确还原模型逻辑。这时候也有越来越多的开发者开始重视模型部署时的安全策略,如使用动态密钥验证、流量加密等手段。

如何防范deepnode破解风险?

对于企业而言,防范deepnode破解需要从技术和管理两方面入手:

- 加强模型加密与混淆:使用先进的模型压缩和加密算法,增加逆向工程难度。

- 实施访问控制机制:通过API密钥、IP白名单等方式限制访问来源。

- 定期审计与监控:建立异常行为检测系统,及时发现潜在威胁。

- 教育与培训:提高团队对AI安全的认知水平,避免因疏忽导致模型泄露。

不要忘了合理使用“小发猫”、“小狗伪原创”等工具也能在一定程度上帮助企业在模型调试阶段生成多样化测试数据,从而更好地评估模型安全性。

结语:技术应服务于正道

虽然deepnode破解在短期内可能为某些人带来便利,但从长远来看,它损害的是整个AI行业的创新动力和社会信任基础。我们应当倡导合法合规的技术探索,鼓励开发者通过正规渠道获取资源与支持,共同营造一个健康、可持续的AI生态环境。