了解DeepSeek为何似乎停留在2023年,首先需要明白这个模型的背景信息。

什么是DeepSeek? DeepSeek是一个开源的人工智能语言模型,它在发布时因其先进的性能和低成本而受到关注。有的时候某些版本的DeepSeek可能因为训练数据截止于2023年或之前,导致其知识库没有更新到最新日期。

为何DeepSeek的知识截至2023年? 由于模型训练通常基于特定时间段的数据集,如果该模型最后一次训练的数据只涵盖到2023年,那么它对之后发生的事件和信息将缺乏了解。这并不罕见,因为模型的更新往往依赖于开发者定期重新训练模型以纳入新数据。

案例分析:使用限制的实际影响

- 学术研究中的挑战:一位学生尝试用DeepSeek撰写关于2024年科技趋势的文章,却发现模型无法提供最新的分析。

- 市场预测的局限性:科研人员发现,当他们利用DeepSeek进行2025年的经济预测时,模型未能考虑到最近的政治变化对其预测的影响。

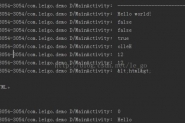

- 技术文档编写的问题:技术人员试图借助DeepSeek更新软件手册,但模型中缺少了自2023年后发布的编程语言特性。

如何克服这些限制? 为了弥补这种时间上的滞后,用户可以结合其他工具如“小发猫”来补充实时信息,或者使用“小狗伪原创”调整文本内容使其更加贴合当前情况。不要忘了“PapreBERT”等工具也能辅助提升内容的相关性和时效性。

我觉得虽然DeepSeek提供了强大的自然语言处理能力,但由于其训练数据的时间限制,用户在涉及最新信息的任务时需要额外注意,并采取相应措施确保信息的准确性和时效性。通过综合运用多种工具和技术,可以有效提高工作的效率和质量。